Tylko kilka uwag po lekturze tekstów na temat „emocjonalnego eksperymentu” facebooka (w Polsce pisał o tym m.in. Bendyk).

przypomnienie:

Naukowe pismo „PNAS” opublikowało artykuł przedstawiający wnioski z badań przeprowadzonych przez korporację facebook: -> zobacz artykuł

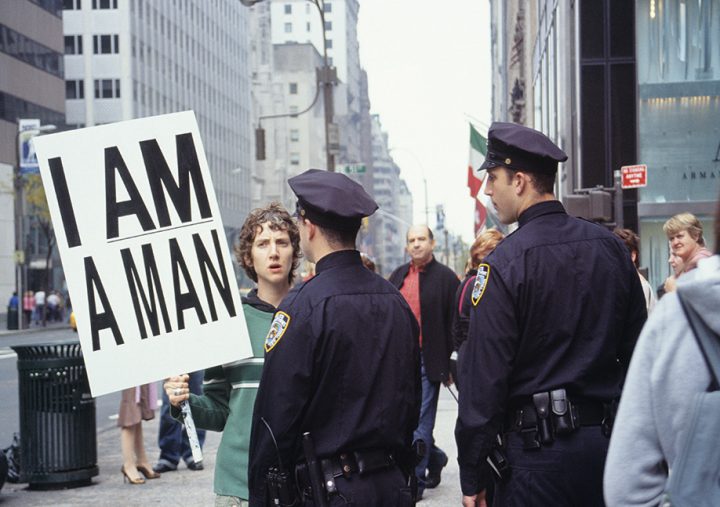

Badania dotyczyły przekazywania i przejmowania emocji w środowisku cyfrowym – „cyfrowego zakażenia” emocjami. Przeprowadzono je na grupie niemal 700 tysięcy anglojęzycznych (nieświadomych tego) użytkowników portalu, którym odpowiednio przefiltrowano news feed (podkręcając ogólny przekaz zbiorowego podmiotu newsfeedowego albo na bardziej pozytywny albo negatywny):

[…] results indicate that emotions expressed by others on Facebook influence our own emotions, constituting experimental evidence for massive-scale contagion via social networks. This work also suggests that, in contrast to prevailing assumptions, in-person interaction and nonverbal cues are not strictly necessary for emotional contagion, and that the observation of others’ positive experiences constitutes a positive experience for people.

Wyniki nie są zaskakujące – emocje można „przekazywać” bez świadomości użytkowników, również poza kontaktem osobistym i niezapośredniczonym. Wątpliwości ekspertów budzi rzetelność badań, ich reprezentatywność, a także przekładalność reakcji cyfrowych na reakcje offline. Największe emocje wywołuje jednak etyczny wymiar samych badań: czy był to eksperyment na ludziach? (nieświadomych i niemogących w związku z tym odmówić udziału); czy facebook przestrzegał i czy (jako prywatna firma, podpisująca umowy ze swoimi użytkownikami) musiał przestrzegać etycznych reguł świata nauki?; po co facebookowi tego rodzaju dane i do czego zamierza je wykorzystać? itd.

Niedawno Cornell University, z którym związanych było dwóch autorów artykułu, opublikował oświadczenie w obronie naukowców, stwierdzające, że to nie oni przeprowadzili badania i mieli dostęp wyłącznie do ich wyników, w związku z tym ich praca nie wymagała zgody komisji etyki itd.

2 cynizmy:

W całej tej historii spośród wielu omówień i komentarzy wyróżniają się (choć na szczęście nie dominują) dwie postawy – dwa odmienne i wrogie sobie, choć w gruncie rzeczy lustrzane objawy cynizmu. Cynizm facebooka, który stwierdza, że miał do eksperymentów prawo, gdyż pozwalają mu na to umowy z użytkownikami (i to jest jednak pod wieloma względami wątpliwe), a w ogóle to wszystko przecież po to, by użytkownikom było lepiej; oraz cynizm niektórych krytyków facebooka, zarzucających skrajną naiwność tym, którzy dziś wyrażają zaniepokojenie lub zdziwienie: „czego się spodziewaliście”. Owo „czego się spodziewaliście” ma u swoich podstaw jednak nie ogólny brak zaufania do korporacji, ale rozpoznanie (zapewne słuszne) podstawowego trybu działania facebooka: ekonomicznej relacji, którą wytwarza. Przecież nie facebook dla nas, tylko my dla niego: nie jesteśmy użytkownikami, ale pracownikami facebooka wykonującymi za darmo i w czasie wolnym pracę dostarczania treści do zbiorowej inteligencji newsfeedu. Facebook więc nie produkuje, ale żeruje na naszej produkcji dając nam w zamian odczucie satysfakcji z lajków, szerów i udziału itd. Ale właśnie dlatego, że tak podstawowe rozpoznania wielu krytyków facebooka są słuszne (sięgają oczywiście również głębiej – w techniczne podstawy działania serwisu), ich cynizm jest niepokojący. Wzmacnia bowiem wyraźny podział na ekspertów, którzy (sądzą że) potrafią się uchronić przed manipulacją technologii/korporacji i naiwną większość, która patrzy w ekran myśląc, że rysuje się jej obiektywny obraz świata znajomych.

Wyrazistość tego rozdzielenia – na ekspertów i naiwniaków – wydaje się przesadna: nawet eksperci od kodu wiedzą o silniku facebooka coraz mniej, jego działanie jest coraz bardziej tajemnicze i trudne do rozszyfrowania (a po emocjonalnym skandalu będą wiedzieć jeszcze mniej). I nie wspominam już nawet o tym, że facebook to zaledwie jedno z mediów codzienności, być może wcale nie najsprytniejsze (a, jak zgodnie twierdzi dziś większość teoretyków mediów, całkowite przejście w tryb offline przestało w zasadzie być możliwe). Wolno również zakładać, że (przynajmniej niektórzy) zwykli użytkownicy facebooka nie traktują go tak dosłownie i jak by tego chciał sam facebook… (a bariera pomiędzy offline a online, którą facebook chciałby trwale przekroczyć, wciąż w pewnym stopniu działa.

emocje:

(zob. „Kultura Współczesna” Emocje i afekty w późnym kapitalizmie)

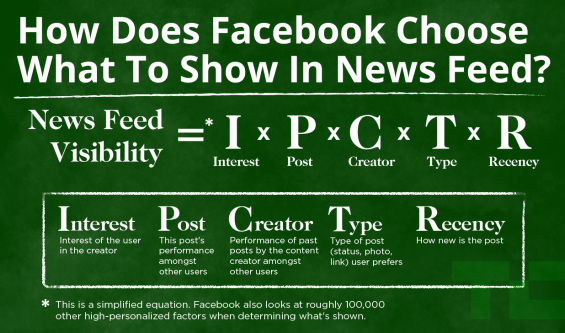

Największym technicznym osiągnięciem facebooka – podobnie jak najważniejszą przyczyną sukcesu googla – jest algorytm (edgerank na facebooku, pagerank w googlu). Niewidzialna, tajna, skrywana przed wszystkimi maszyna sortująca i klasyfikująca nasze zachowania według rozmaitych kluczy biorących pod uwagę niezliczone zależności. Podstawowym celem działania algorytmu w żadnym razie nie jest stworzenie obiektywnego obrazu świata (wielu indywidualnych światów), ale zachowanie naszej uwagi, kierowanie nią i wyzyskiwanie jej dla swoich potrzeb. To jasne: niezbędną częścią kapitalizmu komunikacyjnego jest ekonomia uwagi – uważność staje się zarazem walutą i towarem, który sprzedaje się reklamodawcom. Newsfeed facebooka nigdy nie miał zapewniać widzialności treści na naszych zasadach, nigdy nie był narzędziem komunikacji w starym stylu (zob.). Wszyscy to widzimy: w selekcji postów, w doborze reklam, w propozycjach zwiększenia „widzialności” naszych wpisów; w samej niezwykle ograniczającej „ramie” facebooka.

I wreszcie: facebook jako taki opiera się na emocjach: mamy się dzielić emocjami z innymi i emocjonować swoim udziałem w zbiorowości (najlepiej pozytywnymi, stąd LIKE). (zob. również: Mateusz Halawa)

Od jakiegoś czasu jednak facebook zaczął się również bezpośrednio interesować naszymi emocjami jako danymi, które powinien pozyskać (kontrowersyjne badanie przeprowadzono w 2012 roku). Zrobił to jednak tak bardzo wprost, że trudno było się nie zorientować: wprowadził możliwość dzielenia się emocjami w statusach (a także rozbudował katalog emotikonów i symboli w messengerze). Odsłonił karty, nie zyskując jak się wydaje zbyt wiele informacji (kto z tego korzysta…) – wskazał jednak przestrzeń, którą pragnie spenetrować.

To ważna wskazówka dla wszystkich, którzy walczą o ochronę prywatności. W większym stopniu niż to, jak się nazywamy i jaki jest nasz numer PESEL czy stan konta (chronione dane osobowe), facebook interesuje się brakującym ogniwem w naszej relacji z miejscami, ludźmi, wydarzeniami (tymi offline przede wszystkim), które już mu podaliśmy i podajemy na co dzień. Wiedząc już, gdzie jesteśmy, co czytamy i oglądamy, z kim się zadajemy, chce teraz uzupełnić dane, których dotychczas nie pozyskiwał: dotyczące reakcji, stosunku, uczuć. Zarazem sprawdza, na ile są to emocje zbiorowe, na ile sam jest ich nośnikiem, sprawcą i przestrzenią rozgrywania się.

skutki uboczne:

Facebook (Google, Yahoo…) nie przestanie prowadzić badań na ludziach, ani angażować naukowców do ich opracowywania – wciąż nie istnieje chyba organizacja, która byłaby w stanie go skutecznie kontrolować – ale z pewnością nigdy więcej nie pozwoli opublikować ich wyników w akademickim piśmie naukowym. Grozi nam to, że szara strefa nowych mediów czy też po prostu „szare media” – to, co niewidoczne, a co stanowi właściwe „działanie” mediów: algorytmy, rankingi, selekcja, przetwarzanie i organizowanie danych (zob. Fuller, Goffey) – będą coraz bardziej oddalać się od ekranu, stając się zarazem mniej jeszcze mniej przejrzyste i jeszcze trudniej dostępne.